L’importanza di filmare tutto

Senza le testimonianze collettive ci manca un pezzo fondamentale per smascherare le narrazioni del potere.

È davvero in gioco il valore documentale di una fotografia?

Con le intelligenze artificiali generative si possono creare immagini iper-realistiche. Alcuni sviluppatori di alcuni strumenti stanno bloccando questa possibilità – mentre scrivo, a dicembre 2023, è praticamente impossibile ottenere una fotografia sintetica iper-realistica dalla versione di Dall-e integrata in ChatGPT, per esempio – ma altri non percorrono questa strada. Questo significa che il costo per produrre un’immagine sintetica, una sintografia, iper-realistica, difficile da distinguere da un foto autentica, è sempre più basso e alla portata di chiunque voglia cimentarsi.

Su Reddit c’è, da marzo 2023, una gallery fotografica di sintografie, con tanto di didascalie, di un terremoto con tsunami mai avvenuto. Chi le ha create ha inventato anche il nome e la data: The 2001 Great Cascadia 9.1 Earthquake & Tsunami – Pacific Coast of US/Canada. Questo tipo di produzioni ha fatto allarmare molte persone, che si sono chieste – anche giustamente, da certi punti di vista – fino a che punto si arriverà nella produzione di queste immagini, come influiranno sulla percezione della realtà da parte delle persone, che effetti avranno rispetto alla nostra possibilità o impossibilità di abitare in una realtà condivisa.

Sono preoccupazioni condivisibili. A volte, tuttavia, pare che non siano sufficientemente messe in prospettiva storica. La manipolazione delle immagini non è sempre stata alla portata di tutti – di sicuro non lo era la creazione ex novo –, questo è chiaro. E oggi si può fare in scala e velocemente. Ma la modifica delle fotografie e dei video ha una sua storia ben precisa, che va dai fondali dipinti sulle prime stampe fotografiche a Photoshop, dal dito medio di Varoufakis al framing, dalle immagini fake di Trump arrestato alla propaganda.

Durante la Prima guerra del Golfo, nella notte tra il 26 e il 27 febbraio 1991, gli aerei statunitensi attaccarono e distrussero le unità dell’esercito iracheno in ritirata lungo una superstrada che portava dalla capitale del Kuwait, Kuwait City, verso l’Iraq in direzione di Bassora. La strada fu soprannominata autostrada della morte. Le foto che circolarono – come quella che abbiamo pubblicato, di pubblico dominio – hanno una caratteristica che è stata messa in evidenza da molti analisti. Non si vedono morti. Non si vedono persone. I cadaveri sono stati inceneriti? Sono stati rimossi prima che venisse scattata la foto? Non ce n’erano perché i soldati iracheni semplicemente scapparono prima dei bombardamenti aerei? Non lo sappiamo con esattezza e non lo sapremo mai: non c’è certezza nemmeno sul numero effettivo delle vittime di quella sera.

Sappiamo che è un episodio controverso. Che sono state pubblicate foto di cadaveri sparsi nel deserto che sarebbero stati bruciati da quelle che, all’epoca, si chiamavano “Alleati”, che è uscito un famoso reportage fotografico dal titolo The Unseen Gulf War, oggi visibile solamente grazie all’esistenza di un sito che si chiama archive.org.

Eppure, le foto che hanno visto tutte le persone che all’epoca si informavano sono quelle epurate dalle fastidiose presenze umane.

Che valore documentale hanno, allora, quelle foto?

Le foto hanno un punto di vista. Sono scattate da una certa persona in un certo momento con una certa attrezzatura, un preciso obiettivo fotografico, con un’inquadratura scelta in un certo modo e in un determinato contesto. Quella persona potrebbe avere le proprie motivazioni, potrebbe far parte di un lavoro di gruppo, di un progetto, potrebbe seguire una determinata agenda. Una foto, da sola, non ha il valore documentale di certificazione della realtà che vorremmo avesse. Tant’è che anche le foto che si portano in tribunale possono essere, sì, foto documentali, ma solo a certe condizioni (per esempio, in Italia se vengono contestate dalla controparte non sono valide a fini giuridici).

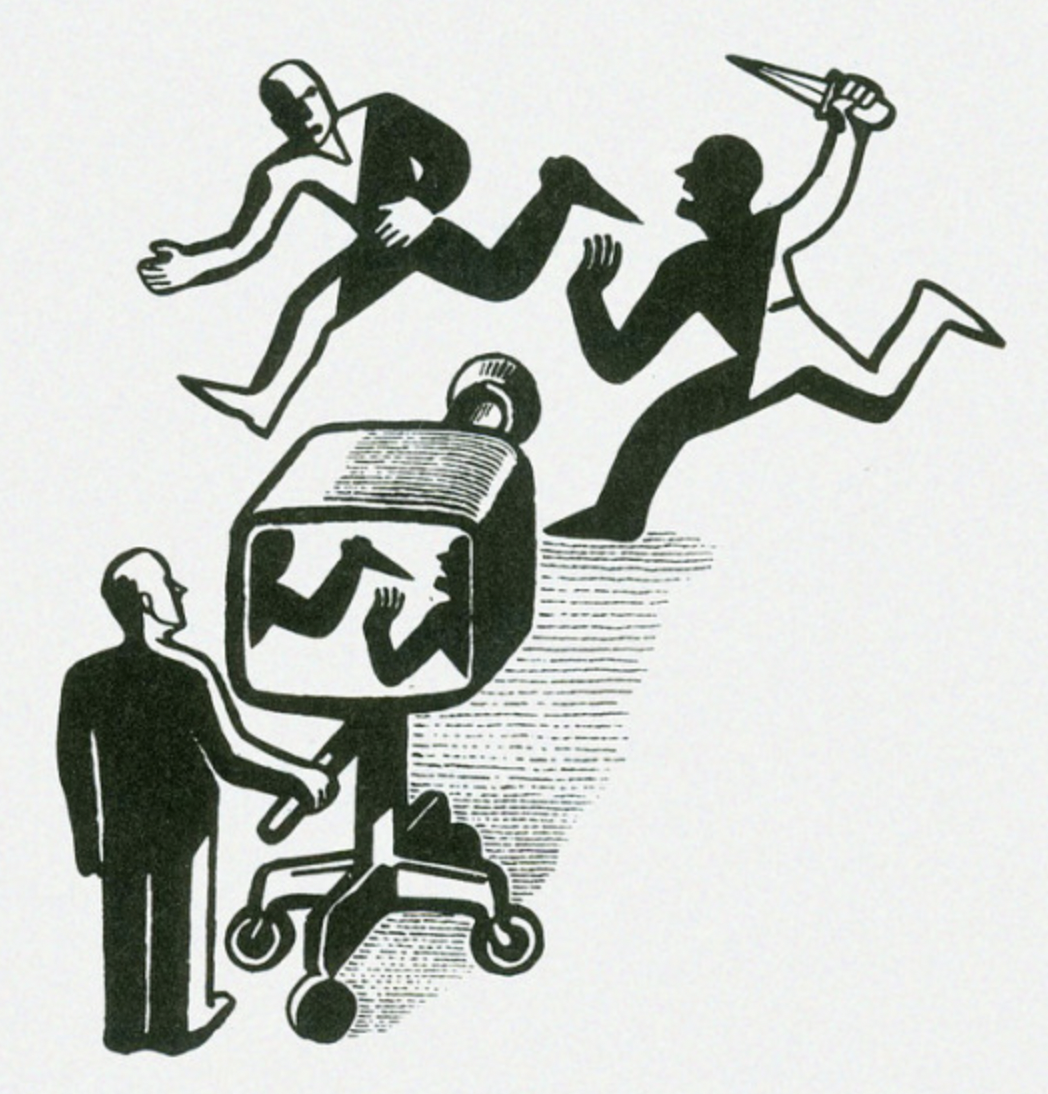

Le foto hanno un framing, cioè “inquadrano” la realtà, la incorniciano, la raccontano in un certo modo. La rappresentano ma non sono la realtà stessa: non lo erano nemmeno prima delle intelligenze artificiali generative. In un certo senso, anche la foto che mostra l’autostrada della morte senza cadaveri è una foto sintetica, anche se non è stata realizzata da un’intelligenza artificiale.

Senza voler negare che i deepfake alla portata di tutti possano rappresentare un problema, non si può far finta che sia un problema di oggi. In qualche modo, se volessimo ribaltare la prospettiva, siamo di fronte a una specie di democratizzazione della possibilità di costruire artefatti fotografici, mentre prima era un’operazione alla portata di chi aveva enormi budget e grandi possibilità di distribuzione del proprio punto di vista. Siamo di fronte anche – ma questo da anni, con l’abbattimento dei costi di produzione e in qualche modo di distribuzione dei contenuti – a una democratizzazione del framing. Persone che prima non avevano voce possono mostrare più facilmente il proprio punto di vista, la propria versione di una storia (almeno in teoria, e comunque sottostando a logiche distributive algoritmiche). Preoccuparsi di questo in un’ottica di mera critica alle intelligenze artificiali generative significa, ancora una volta, spostare l’attenzione dalle questioni umane per rivolgerle alle macchine. È poco utile, rischia di offuscare analisi e sguardi.

Una soluzione potrebbe essere vietare alle persone di utilizzare le intelligenze artificiali generative per generare immagini iper-realistiche. Mentre la scrivo mi chiedo quando sia praticabile, quanto sia utile e persino quanto senso possa avere, ma non escludo che sia un’ipotesi con sostenitori in vari ambiti. A chi ne sostiene l’auspicabilità andrebbe chiesto se, dunque, vieterebbero anche qualsiasi altra forma di framing.

Un’altra soluzione, più realistica, più pratica, più operativa, è quella di smettere di lamentarsi e di produrre analisi del qui e ora e adoperarsi, invece, per costruire una società con più anticorpi nei confronti di qualsiasi tipo di artefatto. Sia quelli che provengono dalle intelligenze artificiali sia quelli che provengono dalle intelligenze umane. Significa diffondere conoscenza, usare gli strumenti, democratizzarne l’accesso, crescere generazioni con competenze specifiche nella lettura di un’immagine, di un video, di un testo, nella ricerca delle fonti, nella verifica. Sicuramente è più faticoso di un divieto. Sospetto, però, che avrebbe ricaschi più positivi.

Senza le testimonianze collettive ci manca un pezzo fondamentale per smascherare le narrazioni del potere.

Esperienze dalla Repubblica Ceca e dalla Romania mostrano che la desegregazione funziona: dove si insegna insieme, tutta la società cresce.

Finanziamenti europei, dati incompleti e progetti “dal basso”: tra numeri e volti, la difficile inclusione dei bambini Rom a Roma.

Tra sgomberi, stereotipi e propaganda, la comunità Rom resta il bersaglio preferito della politica e dei media italiani